Entendiendo el código ASCII y el sistema binario desde una perspectiva técnica clara

El código ASCII y el sistema binario son fundamentales para la comunicación digital en la era moderna. Comprender estos conceptos no solo es esencial para programadores y desarrolladores, sino también para cualquier persona interesada en la tecnología que nos rodea.

En este artículo, nos proponemos explorar los principios básicos detrás de estos sistemas, facilitando así el conocimiento necesario para interactuar de manera efectiva con dispositivos electrónicos. A través de este análisis, buscaremos profundizar en el tema, entendiendo el código ASCII y el sistema binario desde una perspectiva técnica clara.

- Introducción al código ASCII: Historia y Funcionamiento

- El sistema binario: Base de la computación moderna

- Conversión entre ASCII y binario: Cómo se relacionan

- Aplicaciones del código ASCII en la programación

- Errores comunes al trabajar con ASCII y binario

- Perspectivas futuras del código ASCII en la era digital

Introducción al código ASCII: Historia y Funcionamiento

El código ASCII, que significa American Standard Code for Information Interchange, fue desarrollado en la década de 1960 como un estándar para la representación de caracteres en computadoras y dispositivos de comunicación. Inicialmente, se diseñó para facilitar el intercambio de datos entre diferentes sistemas de computación, asegurando que el texto pudiera ser interpretado de manera uniforme independientemente del hardware utilizado.

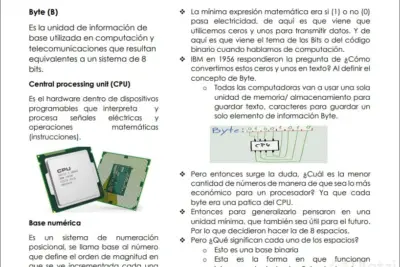

La base del código ASCII está compuesta por 128 caracteres, que incluyen letras, números y símbolos de control. Cada carácter se representa mediante un valor numérico binario de siete bits. Por ejemplo, la letra "A" se representa como 65 en decimal, que corresponde a 1000001 en binario. Esta asignación permite que las computadoras reconozcan y procesen texto de forma efectiva.

A lo largo de los años, el código ASCII ha evolucionado, y se han desarrollado extensiones como ASCII extendido, que utiliza un byte completo (8 bits) para incluir 256 caracteres, permitiendo así la representación de caracteres especiales y letras acentuadas. Esto resulta especialmente útil en la programación y en la creación de aplicaciones que requieren un conjunto más amplio de símbolos. A continuación, se presentan ejemplos de algunos caracteres y sus representaciones en ASCII:

Otro articulo de ayuda: Todo lo que necesitas saber sobre la computadora mainframe y su relevancia en el mundo actual

Todo lo que necesitas saber sobre la computadora mainframe y su relevancia en el mundo actual| Carácter | Decimal | Binario |

|---|---|---|

| A | 65 | 1000001 |

| B | 66 | 1000010 |

| 1 | 49 | 00110001 |

| @ | 64 | 0100000 |

El sistema binario: Base de la computación moderna

El sistema binario es la base de la computación moderna, siendo el lenguaje fundamental que utilizan las máquinas para procesar información. Este sistema se compone únicamente de dos dígitos, 0 y 1, lo que permite representar cualquier tipo de dato, ya sea texto, imágenes o sonidos. A través de combinaciones de estos dos números, se pueden formar instrucciones y datos que las computadoras interpretan y ejecutan.

Una de las principales ventajas del sistema binario es su simplicidad, lo que reduce el riesgo de errores en el procesamiento de información. Dado que las computadoras están diseñadas para trabajar con señales eléctricas, el uso de dos estados (encendido y apagado) se traduce perfectamente en los dígitos binarios. Esto permite un manejo más eficiente de los recursos, contribuyendo al rendimiento general de los sistemas computacionales.

Además, el sistema binario es fundamental para el almacenamiento de datos. Cada bit (la unidad más pequeña de información en binario) puede representar un estado, y agrupando bits en bytes se obtienen representaciones más complejas. Por ejemplo, un byte compuesto por 8 bits puede representar 256 valores distintos, lo que es esencial para la codificación de caracteres en estándares como el ASCII.

En resumen, el sistema binario no solo es el lenguaje que las computadoras utilizan para comunicarse, sino que también establece las bases sobre las que se construyen sistemas más complejos, como programas y aplicaciones. Su importancia radica en que todos los procesos digitales, desde los más simples hasta los más avanzados, dependen de esta representación binaria para funcionar correctamente.

Conversión entre ASCII y binario: Cómo se relacionan

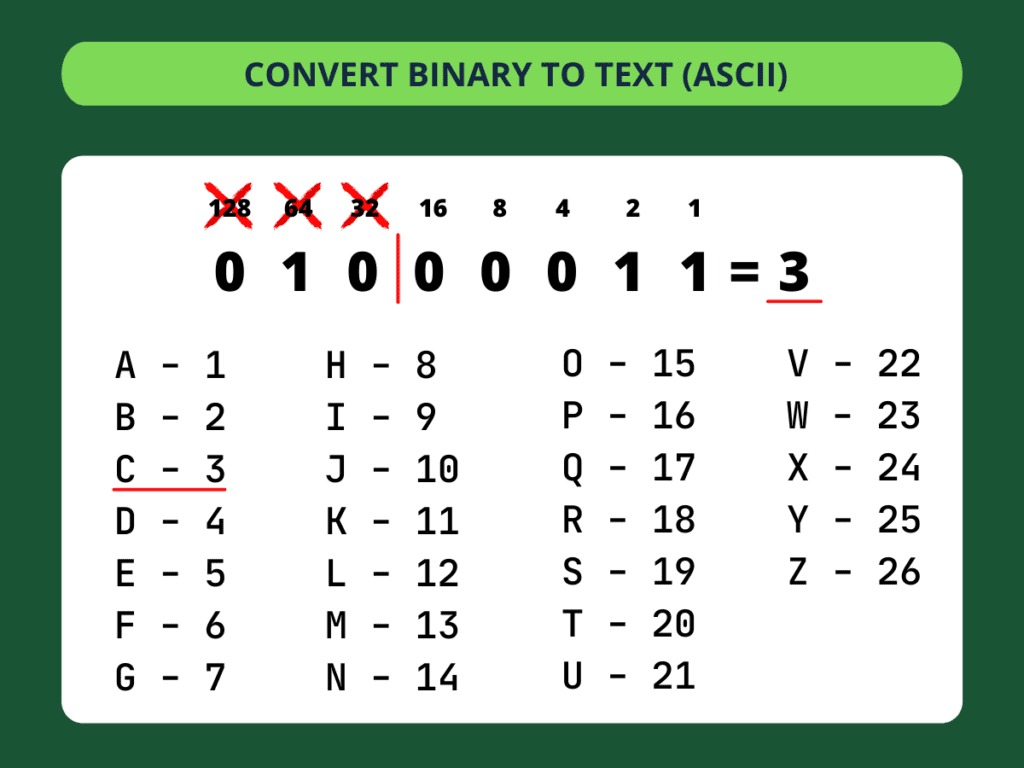

La conversión entre ASCII y binario es un proceso fundamental en la representación de caracteres en computación. Cada carácter del código ASCII se traduce a un valor binario, lo que permite a las computadoras almacenar y procesar texto de manera eficiente. Por ejemplo, el carácter "A" en ASCII tiene un valor decimal de 65, que se convierte a binario como 1000001.

El proceso de conversión puede realizarse fácilmente utilizando tablas de referencia que relacionen los valores decimales, ASCII y sus correspondientes representaciones binarias. A continuación, se presenta una lista de algunos caracteres ASCII comunes y sus conversiones:

- Carácter "B": Decimal 66, Binario 1000010

- Carácter "1": Decimal 49, Binario 00110001

- Carácter "@": Decimal 64, Binario 0100000

La relación entre ASCII y el sistema binario no solo es teórica, sino que tiene aplicaciones prácticas en programación y desarrollo de software. Los desarrolladores necesitan conocer cómo convertir entre estos formatos para manipular datos de texto y garantizar que la información se procese correctamente en diversos sistemas. Para ilustrar esta conversión, se puede observar la siguiente tabla:

| Carácter | Decimal | Binario |

|---|---|---|

| A | 65 | 1000001 |

| B | 66 | 1000010 |

| C | 67 | 1000011 |

| D | 68 | 1000100 |

Aplicaciones del código ASCII en la programación

El código ASCII tiene múltiples aplicaciones en la programación, siendo una de las más relevantes la representación de texto en lenguajes de programación. Los programadores utilizan ASCII para definir cadenas de caracteres, asegurando que los textos sean interpretados correctamente por las computadoras. Además, al utilizar ASCII, se facilita la manipulación de datos, ya que se puede trabajar con caracteres de manera directa sin necesidad de realizar conversiones complejas.

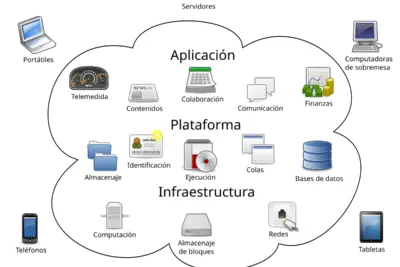

Otra aplicación importante del código ASCII se encuentra en la comunicación entre dispositivos. En sistemas embebidos y dispositivos de Internet de las Cosas (IoT), ASCII se utiliza para enviar comandos y recibir respuestas a través de protocolos de comunicación. Esto permite que distintos dispositivos, independientemente de su diseño, puedan intercambiar información de manera estandarizada y eficiente, lo que es crucial para el funcionamiento de redes modernas.

Además, el código ASCII es fundamental en el desarrollo de archivos de texto y en la programación de aplicaciones que requieren procesamiento de datos. Por ejemplo, formatos de archivo como CSV (Comma-Separated Values) y TXT utilizan ASCII para el almacenamiento de datos en texto plano. Esto simplifica la integración de datos entre diferentes sistemas, dado que ASCII es ampliamente reconocido y fácil de manejar.

Finalmente, los programadores también aplican el código ASCII en el manejo de errores y depuración. Los mensajes de error y las salidas de depuración suelen estar codificados en ASCII, lo que facilita su lectura y comprensión. Al utilizar valores ASCII, los desarrolladores pueden identificar rápidamente problemas en el código y optimizar el rendimiento de sus aplicaciones, garantizando una experiencia de usuario más fluida y eficiente.

Errores comunes al trabajar con ASCII y binario

Al trabajar con el código ASCII y el sistema binario, uno de los errores comunes es la confusión entre los sistemas de numeración. Muchas personas tienden a mezclar la representación decimal con la binaria, lo que puede llevar a errores en la conversión de caracteres. Es crucial recordar que cada carácter ASCII tiene un valor específico en decimal, que se convierte a un formato binario correspondiente. La falta de atención a esta diferencia puede resultar en datos incorrectos o pérdidas de información durante el procesamiento.

Otro error frecuente es el uso inapropiado de la codificación. A menudo, los desarrolladores pueden olvidar que el código ASCII estándar solo incluye 128 caracteres, lo que significa que caracteres especiales o letras acentuadas no serán reconocidos. Para evitar esto, es importante utilizar el ASCII extendido cuando se necesiten más símbolos, como en aplicaciones que manejan múltiples idiomas. Esto asegura una representación precisa de la información.

También se producen errores al interpretar datos binarios. Un mal entendimiento de la representación de bits y bytes puede llevar a la manipulación incorrecta de datos. Por ejemplo, al trabajar con bytes, es común que se asuma que un conjunto de 8 bits se puede leer de cualquier manera, cuando en realidad, cada bit tiene un significado específico en el contexto de la codificación. Es esencial tener una comprensión clara de cómo se estructuran los datos binarios para evitar confusiones y errores en la programación.

Finalmente, la falta de atención a la codificación de caracteres también puede causar problemas de compatibilidad entre diferentes sistemas. Cuando se transfieren datos que contienen caracteres ASCII entre plataformas que pueden utilizar diferentes estándares de codificación, es posible que algunos caracteres no se interpreten correctamente. Para evitar esto, es recomendable verificar la compatibilidad de codificación antes de realizar cualquier transferencia de datos, asegurando que la información se mantenga intacta y sin alteraciones.

Perspectivas futuras del código ASCII en la era digital

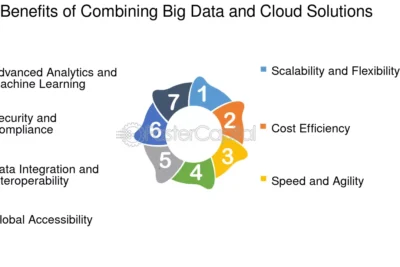

En la era digital actual, el código ASCII sigue desempeñando un papel importante, aunque se enfrenta a desafíos por la aparición de estándares más complejos como UTF-8 y Unicode, que permiten una representación más amplia de caracteres. Sin embargo, hay perspectivas futuras que sugieren que ASCII podría coexistir con estas nuevas tecnologías. La simplicidad del ASCII lo hace ideal para aplicaciones de bajo consumo y dispositivos con recursos limitados, donde la eficiencia es crucial.

Además, el código ASCII podría encontrar nuevas aplicaciones en áreas emergentes como el Internet de las Cosas (IoT). En estos sistemas, donde los dispositivos comunican información de manera constante, la facilidad de uso y la estandarización del ASCII pueden facilitar la interoperabilidad. Esto permitirá que diferentes dispositivos, independientemente de su fabricación, se comuniquen de manera efectiva y rápida, manteniendo la esencia de la comunicación digital.

La educación y la capacitación en programación también podrían beneficiarse del uso continuado del código ASCII. A medida que los nuevos programadores aprenden sobre los fundamentos de la computación, el conocimiento de ASCII les proporciona una base sólida para entender conceptos más complejos. Esto es especialmente relevante en cursos introductorios donde se enseña la conversión binaria y la representación de caracteres, ayudando a los estudiantes a construir un entendimiento claro de cómo funcionan los datos a nivel fundamental.

- Interoperabilidad en dispositivos IoT

- Facilitación de la enseñanza de conceptos básicos de programación

- Compatibilidad con sistemas de bajo consumo

Deja una respuesta

Contenido relacionado