El Fine Tuning en Modelos de Aprendizaje Automático es la Clave para Mejores Resultados

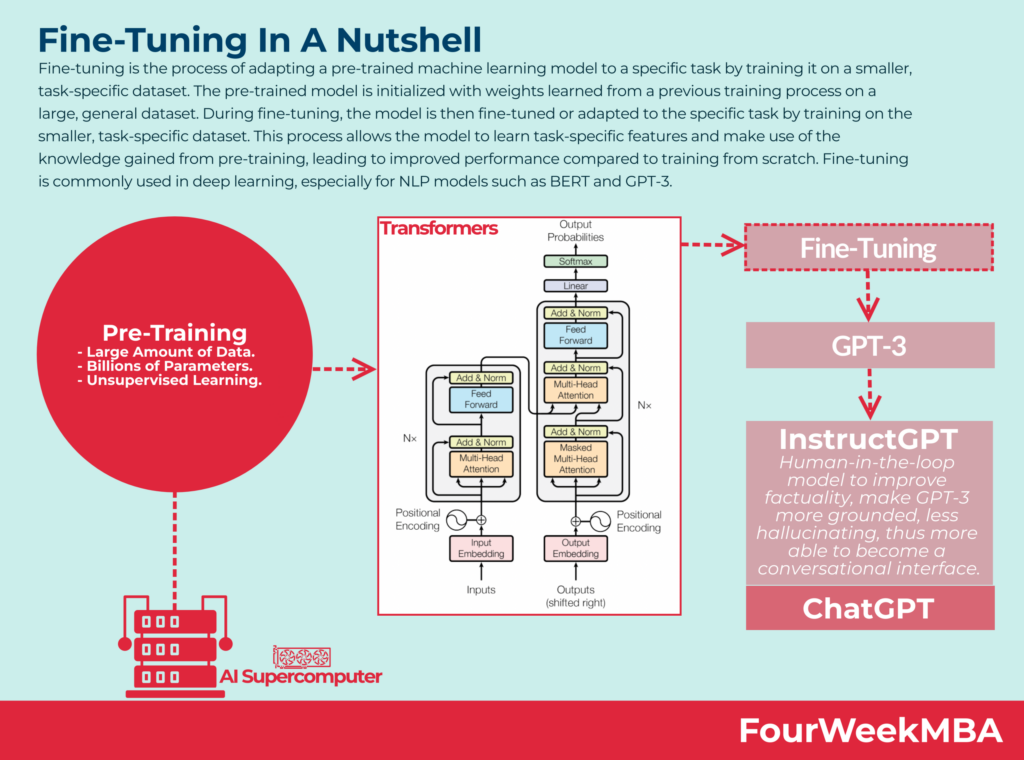

En el mundo del aprendizaje automático, la precisión y la eficiencia son elementos esenciales para el éxito de cualquier modelo. A medida que los datos y las aplicaciones continúan evolucionando, surge la necesidad de adaptar los modelos preentrenados a tareas específicas. Este proceso de ajuste fino, conocido como fine tuning, permite optimizar el rendimiento de los modelos en contextos particulares.

El Fine Tuning en Modelos de Aprendizaje Automático es la Clave para Mejores Resultados, ya que permite a los desarrolladores aprovechar el conocimiento previamente adquirido por los modelos y ajustarlo a nuevas necesidades. Este enfoque no solo mejora la precisión, sino que también ahorra tiempo y recursos al evitar el entrenamiento desde cero, haciendo del fine tuning una estrategia indispensable en el campo de la inteligencia artificial.

- El impacto del fine tuning en el rendimiento de modelos de aprendizaje automático

- Cómo el fine tuning mejora la precisión de los modelos de machine learning

- Técnicas efectivas de fine tuning en modelos de aprendizaje profundo

- Ventajas del fine tuning en comparación con el entrenamiento desde cero

- Errores comunes al aplicar fine tuning en modelos de aprendizaje automático

- El futuro del fine tuning en el desarrollo de inteligencia artificial

El impacto del fine tuning en el rendimiento de modelos de aprendizaje automático

El fine tuning desempeña un papel crucial en la mejora del rendimiento de los modelos de aprendizaje automático. Al ajustar los parámetros de un modelo preentrenado, los desarrolladores pueden adaptar sus capacidades a dominios específicos, lo que resulta en un aumento significativo en la precisión y la efectividad en la resolución de tareas. Este ajuste permite que el modelo aprenda características relevantes de los datos nuevos, optimizando así su utilidad en aplicaciones concretas.

Una de las ventajas más destacadas del fine tuning es su capacidad para reducir el tiempo de entrenamiento necesario. En lugar de iniciar un proceso de aprendizaje desde cero, los modelos pueden beneficiarse de las representaciones generales que ya han sido aprendidas. Esto no solo acelera el tiempo de desarrollo, sino que también minimiza el uso de recursos computacionales. A continuación, se presentan algunos de los beneficios clave del fine tuning:

- Adaptabilidad: Permite que los modelos se ajusten a diferentes contextos y tipos de datos.

- Precisión mejorada: Aumenta la exactitud en la predicción al enfocarse en características relevantes del nuevo conjunto de datos.

- Reducción de costos: Disminuye la necesidad de grandes volúmenes de datos etiquetados para el entrenamiento desde cero.

El impacto del fine tuning se puede observar no solo en la precisión, sino también en la robustez del modelo frente a situaciones cambiantes. Un modelo ajustado finamente tiene una mejor capacidad para generalizar y adaptarse a nuevas entradas, lo que es fundamental en entornos donde los datos pueden variar con frecuencia. Esta característica de resiliencia es vital para aplicaciones en sectores como la salud, la finanza y la automoción, donde las decisiones basadas en datos deben ser rápidas y precisas.

Otro articulo de ayuda: Cómo Watson de IBM Está Transformando la Inteligencia Artificial y el Aprendizaje Automático en el Mundo Empresarial

Cómo Watson de IBM Está Transformando la Inteligencia Artificial y el Aprendizaje Automático en el Mundo EmpresarialCómo el fine tuning mejora la precisión de los modelos de machine learning

El proceso de fine tuning permite ajustar modelos preentrenados para abordar tareas específicas, lo que se traduce en una mejora notable en su precisión. Esta técnica se basa en retocar los parámetros del modelo utilizando un conjunto de datos más pequeño y relevante, lo que permite al modelo captar las particularidades del nuevo contexto. Como resultado, la capacidad del modelo para realizar predicciones certeras aumenta, haciendo que su aplicación en situaciones del mundo real sea mucho más efectiva.

Además, el fine tuning no solo mejora la precisión, sino que también facilita una adaptación más rápida a los cambios en los datos. Esta adaptabilidad es esencial en un entorno donde la información puede cambiar constantemente. Por ejemplo, un modelo de detección de fraudes en tarjetas de crédito puede ajustarse rápidamente a nuevas tendencias en el comportamiento del consumidor, garantizando que las respuestas del modelo sean siempre relevantes y precisas.

Entre los beneficios adicionales del fine tuning, se destacan los siguientes:

- Ahorro de tiempo: Reduce significativamente el tiempo de entrenamiento al aprovechar el conocimiento acumulado por el modelo preentrenado.

- Menor necesidad de datos: Disminuye la dependencia de grandes volúmenes de datos etiquetados, lo que puede ser costoso y complicado de obtener.

- Mejor rendimiento: Aumenta la capacidad del modelo para generalizar, lo que es crítico en aplicaciones donde se requiere flexibilidad y precisión.

En conclusión, el fine tuning se ha convertido en una estrategia clave en el aprendizaje automático debido a su capacidad para mejorar la precisión y la eficiencia de los modelos. Con su capacidad para adaptar los modelos preentrenados a nuevas situaciones y requerimientos, no solo se optimizan los recursos sino que también se asegura un rendimiento robusto en un mundo en constante evolución. Así, esta técnica se presenta como un elemento esencial para el desarrollo eficaz de soluciones basadas en inteligencia artificial.

Técnicas efectivas de fine tuning en modelos de aprendizaje profundo

Las técnicas de fine tuning en modelos de aprendizaje profundo pueden variar en su enfoque y efectividad. Una estrategia común es el ajuste de la tasa de aprendizaje, que implica modificar este parámetro para asegurar que el modelo se adapte sin perder la información valiosa del preentrenamiento. Esto es crucial, ya que una tasa de aprendizaje demasiado alta puede llevar a un sobreajuste, mientras que una demasiado baja puede resultar en un aprendizaje ineficiente.

Otra técnica efectiva se basa en el uso de congelamiento de capas, donde se detiene el entrenamiento de algunas capas del modelo preentrenado mientras se entrenan otras. Esto permite que el modelo mantenga las características generales aprendidas, al tiempo que se especializa en las nuevas tareas. Las capas superiores, que generalmente capturan características más específicas, se ajustan más, mientras que las capas inferiores, que aprenden características más generales, se mantienen intactas.

Adicionalmente, el uso de técnicas de aumento de datos puede ser beneficioso durante el fine tuning. Al generar variaciones en los datos de entrenamiento, como rotaciones, escalados y cambios en la iluminación, se puede mejorar la robustez del modelo. Esto permite que el modelo sea más adaptable y generalice mejor, lo que es fundamental en aplicaciones del mundo real donde los datos pueden ser ruidosos o variar en calidad.

| Técnica | Descripción | Beneficios |

|---|---|---|

| Ajuste de tasa de aprendizaje | Modificar la tasa de aprendizaje para una adaptación más efectiva. | Previene el sobreajuste y mejora la eficiencia del aprendizaje. |

| Congelamiento de capas | Detener el entrenamiento de ciertas capas para preservar características generales. | Permite especialización sin perder representaciones útiles. |

| Aumento de datos | Generar variaciones en los datos de entrada para enriquecer el conjunto de entrenamiento. | Mejora la robustez y la capacidad de generalización del modelo. |

Ventajas del fine tuning en comparación con el entrenamiento desde cero

El fine tuning ofrece una serie de ventajas comparativas sobre el entrenamiento desde cero que lo convierten en una opción preferida en muchos proyectos de aprendizaje automático. En primer lugar, permite un uso más eficiente de los recursos, ya que los modelos preentrenados ya poseen conocimiento general que puede ser aprovechado, lo que significa que se requiere menos tiempo y menos datos para obtener buenos resultados. Esto es particularmente valioso en escenarios donde los recursos son limitados o costosos.

Además, el fine tuning mejora la precisión de los modelos de manera significativa. Al ajustar un modelo preentrenado a un conjunto de datos específico, se pueden captar matices y particularidades que serían difíciles de aprender desde cero. Esto se traduce en un mejor rendimiento en tareas específicas, haciendo que el modelo sea más efectivo en situaciones del mundo real.

Otro aspecto importante es la adaptabilidad del modelo. A medida que los datos evolucionan, el fine tuning permite ajustar rápidamente el modelo a nuevas tendencias o cambios en el comportamiento, lo cual es esencial en campos como el comercio electrónico o la detección de fraudes. La capacidad de adaptarse sin necesidad de un nuevo entrenamiento completo hace que esta técnica sea altamente deseable para empresas que buscan mantenerse competitivas.

Por último, el fine tuning también reduce la dependencia de grandes volúmenes de datos etiquetados. Esto es un gran alivio en situaciones donde obtener datos de calidad es complicado y costoso. Al necesitar menos datos para alcanzar un rendimiento óptimo, las organizaciones pueden enfocar sus esfuerzos en otras áreas, optimizando así su tiempo y recursos en el desarrollo de modelos más robustos.

Errores comunes al aplicar fine tuning en modelos de aprendizaje automático

Uno de los errores más comunes al aplicar fine tuning en modelos de aprendizaje automático es no ajustar adecuadamente la tasa de aprendizaje. Una tasa de aprendizaje demasiado alta puede provocar que el modelo se sobresature y pierda las representaciones generales aprendidas, mientras que una tasa demasiado baja puede llevar a un aprendizaje ineficiente. Por lo tanto, es crucial realizar pruebas y ajustes para encontrar el equilibrio adecuado que permita al modelo adaptarse sin perder información valiosa.

Otro error frecuente es el uso incorrecto de conjuntos de datos. A menudo, los desarrolladores tienden a utilizar datos no representativos o de baja calidad para el fine tuning, lo que puede llevar a un rendimiento deficiente del modelo. Es esencial asegurarse de que los datos utilizados sean relevantes y de alta calidad, ya que esto impactará directamente en la capacidad del modelo para generalizar y adaptarse a nuevas situaciones.

Además, no considerar el congelamiento de capas puede ser un error crítico. Algunos desarrolladores pueden optar por entrenar todas las capas del modelo, lo que podría resultar en la pérdida de características generales que el modelo preentrenado ya ha adquirido. Congelar ciertas capas y ajustar solo las capas superiores permite una especialización más efectiva en las nuevas tareas, preservando las representaciones útiles aprendidas anteriormente.

Por último, la falta de validación y ajuste del modelo después del fine tuning es un error que puede pasar desapercibido. Es fundamental realizar una validación exhaustiva utilizando un conjunto de datos de prueba adecuado para evaluar el rendimiento del modelo ajustado. Sin esta evaluación, es difícil identificar si el fine tuning ha tenido un impacto positivo o negativo, lo que puede llevar a decisiones inadecuadas en su implementación en entornos reales.

El futuro del fine tuning en el desarrollo de inteligencia artificial

El futuro del fine tuning en el desarrollo de inteligencia artificial se vislumbra lleno de oportunidades gracias a la constante evolución de la tecnología y los datos. A medida que los modelos preentrenados se vuelven más sofisticados y accesibles, el ajuste fino se transformará en una técnica aún más esencial para personalizar inteligencia artificial en diversos sectores. Esta personalización permitirá a las empresas adaptar modelos a sus necesidades específicas de manera más rápida y eficiente.

Además, la integración de técnicas avanzadas de aprendizaje transferido y la optimización de algoritmos de ajuste fino abrirán nuevas posibilidades. Con el uso de modelos multitarea y la capacidad de transferir conocimientos entre diferentes tareas, el fine tuning permitirá que los modelos sean más versátiles, facilitando su aplicación en áreas como la salud, la educación y el comercio. Las siguientes tendencias marcarán el camino hacia el futuro del fine tuning:

- Modelos más grandes y complejos: A medida que la capacidad computacional crece, se desarrollarán modelos de IA más robustos que necesitarán un fine tuning más especializado.

- Ajuste automatizado: Tecnologías emergentes permitirán la automatización del proceso de fine tuning, haciendo que sea accesible incluso para aquellos sin experiencia técnica.

- Colaboración entre humanos y máquinas: Se espera que los sistemas de IA trabajen en estrecha colaboración con los humanos, mejorando continuamente su rendimiento a través del fine tuning basado en feedback humano.

Por último, la ética y la transparencia jugarán un papel crucial en el futuro del fine tuning. A medida que los modelos se vuelven más integrales en la toma de decisiones, la capacidad de auditar y entender cómo se ajustan y adaptan a nuevas tareas será esencial. La implementación de marcos éticos y de gobernanza en el fine tuning asegurará que los modelos no solo sean precisos, sino también responsables y justos en su funcionamiento.

Deja una respuesta

Contenido relacionado