Todo lo que Necesitas Saber sobre la Tabla del Código ASCII y su Aplicación en Informatica

El código ASCII, que significa American Standard Code for Information Interchange, es un sistema de codificación que asigna valores numéricos a caracteres, permitiendo que las computadoras interpreten texto. Esta tabla ha sido fundamental en la evolución de la informática, ya que establece un estándar que facilita la comunicación entre diferentes dispositivos y software.

En este artículo, exploraremos Todo lo que Necesitas Saber sobre la Tabla del Código ASCII y su Aplicación en Informatica, abarcando su historia, estructura y su relevancia en la programación y el desarrollo de software. Comprender el código ASCII es esencial para cualquier profesional del área, ya que es la base sobre la cual se construyen muchas aplicaciones modernas.

- Introducción a la Tabla del Código ASCII: Historia y Conceptos Fundamentales

- ¿Para qué se utiliza el Código ASCII en Informática? Aplicaciones y Ejemplos Prácticos

- Diferencias entre ASCII y Unicode: ¿Por qué es Importante Conocerlas?

- Los Caracteres Especiales en la Tabla del Código ASCII: Usos y Significados

- Cómo Interpretar la Tabla del Código ASCII: Guía para Principiantes

- Errores Comunes al Usar el Código ASCII en Programación y Cómo Evitarlos

Introducción a la Tabla del Código ASCII: Historia y Conceptos Fundamentales

La Tabla del Código ASCII se estableció en la década de 1960 como un estándar común para la representación de caracteres en computadoras y dispositivos electrónicos. Su creación fue impulsada por la necesidad de un sistema de codificación que facilitara la comunicación entre diferentes sistemas informáticos, lo que resultó en una mayor interoperabilidad. Antes de ASCII, existían numerosos sistemas de codificación que complicaban la tarea de compartir información.

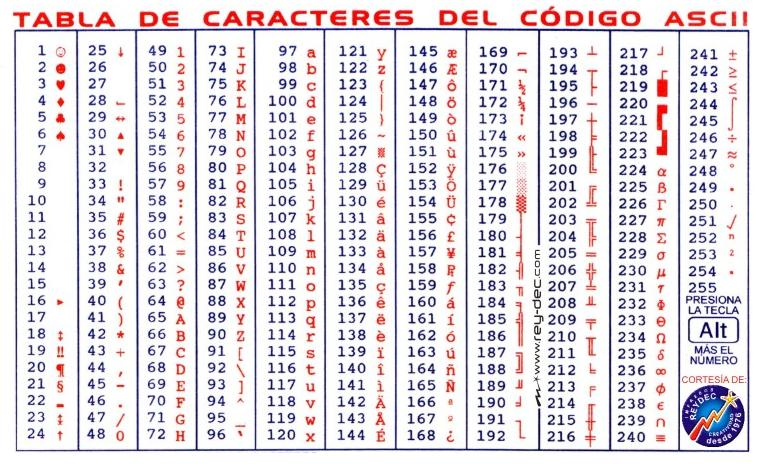

Este código asigna un valor numérico a cada carácter, incluyendo letras, números y símbolos de puntuación. Se compone de 128 caracteres, de los cuales 33 son caracteres de control (no imprimibles). Los conceptos fundamentales del ASCII incluyen:

- Codificación unidimensional: Cada carácter corresponde a un número decimal único.

- Compatibilidad: Permite el uso de caracteres en diferentes plataformas y lenguajes de programación.

- Extensibilidad: A pesar de sus limitaciones, ha servido como base para otros sistemas de codificación más complejos.

A lo largo de los años, el ASCII ha evolucionado y ha dado lugar a variantes, como el ASCII extendido, que permite la inclusión de caracteres adicionales para lenguas distintas al inglés. Esta expansión ha sido crucial para soportar diversos sistemas operativos y aplicaciones que requieren un conjunto de caracteres más amplio. Sin embargo, el ASCII sigue siendo utilizado ampliamente en la programación y el desarrollo de software, dado su carácter simple y directo.

Otro articulo de ayuda: Cómo utilizar la función DIM en programación para gestionar dimensiones dinámicas

Cómo utilizar la función DIM en programación para gestionar dimensiones dinámicasLa relevancia del código ASCII se puede resumir en su papel como "puente" entre el hardware y el software, permitiendo que los datos se transmitan de manera eficiente. Su estructura sencilla ha hecho que siga siendo un componente esencial en la informática moderna, principalmente en escenarios que requieren una manipulación de texto básica. A pesar del avance hacia codificaciones más complejas, el entendimiento del ASCII es fundamental para cualquiera que desee profundizar en el mundo de la programación.

¿Para qué se utiliza el Código ASCII en Informática? Aplicaciones y Ejemplos Prácticos

El código ASCII se utiliza en informática para facilitar la comunicación entre dispositivos y sistemas operativos. Al asignar un valor numérico a caracteres, permite que diferentes programas y hardware interpreten el texto de la misma manera. Esto es especialmente útil en situaciones donde se requiere la transferencia de datos entre sistemas que pueden no ser idénticos, garantizando así la interoperabilidad.

Entre las aplicaciones más comunes del código ASCII se encuentran:

- Programación: Los lenguajes de programación utilizan ASCII para representar variables y cadenas de texto.

- Protocolo de comunicación: Los datos transmitidos a través de redes suelen estar codificados en ASCII, permitiendo una fácil interpretación por diferentes sistemas.

- Edición de texto: Muchas aplicaciones de procesamiento de texto y editores de código se basan en ASCII para la creación y modificación de archivos de texto plano.

Un ejemplo práctico de su uso se observa en la creación de archivos .txt, donde cada carácter es almacenado en su forma ASCII correspondiente. Esto permite que los archivos sean abiertos y leídos en distintas plataformas sin perder información, manteniendo la integridad de los datos. Además, en la programación, los desarrolladores frecuentemente utilizan funciones que manipulan cadenas de texto en formato ASCII para realizar tareas como la codificación y la conversión de datos.

Finalmente, el código ASCII juega un papel crucial en la depuración de software. Cuando los desarrolladores necesitan visualizar o registrar datos, el uso de ASCII les permite entender mejor los valores subyacentes de los caracteres y facilita la identificación de errores. En resumen, el conocimiento y la aplicación del código ASCII son fundamentales en diversos aspectos de la informática, desde la programación hasta la transferencia de datos.

Diferencias entre ASCII y Unicode: ¿Por qué es Importante Conocerlas?

La principal diferencia entre ASCII y Unicode radica en la cantidad de caracteres que cada uno puede representar. Mientras que ASCII comprende solo 128 caracteres, incluyendo letras, números y algunos símbolos, Unicode ha sido diseñado para incluir una vasta gama de caracteres de diferentes idiomas y sistemas de escritura. Esto es fundamental en un mundo globalizado donde la diversidad lingüística es cada vez más prominente.

La importancia de conocer estas diferencias se manifiesta en varias áreas clave:

- Compatibilidad: ASCII es ideal para sistemas que solo requieren el alfabeto inglés, pero Unicode es esencial para aplicaciones que deben manejar varios idiomas.

- Interoperabilidad: Con Unicode, se pueden compartir documentos y datos entre diferentes plataformas sin perder información, mientras que ASCII puede ser limitado en este aspecto.

- Futuro en programación: La mayoría de los lenguajes de programación modernos favorecen Unicode, lo que facilita el desarrollo de software internacionalizado.

En términos de implementación, ASCII es más sencillo y rápido debido a su limitada cantidad de caracteres, lo que puede ser ventajoso en sistemas con recursos restringidos. Sin embargo, Unicode, al ser más complejo, permite una representación más rica de textos. Esto es particularmente útil en aplicaciones como bases de datos y páginas web que necesitan mostrar contenido diverso y multilingüe.

Una comparación visual puede ayudar a entender mejor estas diferencias:

| Característica | ASCII | Unicode |

|---|---|---|

| Carácteres Soportados | 128 | Más de 143,000 |

| Lenguajes Soportados | Principalmente inglés | Multilingüe |

| Uso Común | Aplicaciones básicas | Aplicaciones internacionales |

Los Caracteres Especiales en la Tabla del Código ASCII: Usos y Significados

Los caracteres especiales en la tabla del código ASCII son fundamentales para la interacción entre el usuario y las computadoras. Estos caracteres no solo comprenden símbolos de puntuación y signos matemáticos, sino que también incluyen caracteres de control que permiten gestionar la forma en que se procesa y visualiza la información. Entre los caracteres de control más relevantes se encuentran el Carácter de Nueva Línea (LF) y el Carácter de Retorno de Carro (CR), que son esenciales para la organización del texto en la pantalla y en archivos.

Además de los caracteres de control, el ASCII incluye una variedad de símbolos que se utilizan en programación, como el signo de adición (+), el signo de igual (=) y el signo de asterisco (*). Estos símbolos son usados en expresiones matemáticas y lógicas, permitiendo a los programadores realizar operaciones y evaluaciones de forma sencilla. La capacidad de representar estos caracteres especiales es crucial para el desarrollo de algoritmos y la creación de software funcional.

Los caracteres especiales también desempeñan un papel importante en el diseño de interfaces de usuario. Por ejemplo, símbolos como el ampersand (&) y el signo de porcentaje (%) pueden ser utilizados en menús y botones, mejorando la experiencia del usuario al hacerla más intuitiva. Esto hace que la comprensión y el uso del código ASCII resulten esenciales no solo para programadores, sino también para diseñadores de software que buscan crear aplicaciones accesibles y amigables.

En resumen, los caracteres especiales del código ASCII tienen aplicaciones prácticas en múltiples aspectos de la informática. Su uso en programación, diseño de interfaces y manejo de texto los convierte en elementos indispensables para cualquier profesional en el campo. Comprender sus usos y significados no solo contribuye a un mejor manejo de la información, sino que también capacita a los usuarios para aprovechar al máximo las herramientas tecnológicas disponibles.

Cómo Interpretar la Tabla del Código ASCII: Guía para Principiantes

Interpretar la tabla del código ASCII es un proceso sencillo pero fundamental para quienes inician en el mundo de la programación y la informática. Cada carácter en esta tabla se relaciona con un número decimal, lo que significa que para utilizar textos en código, es esencial conocer estos valores. Por ejemplo, la letra "A" representa el número 65, mientras que el espacio en blanco tiene un valor de 32. Este conocimiento básico permite a los principiantes comprender cómo se almacenan y procesan los datos en las computadoras.

Para facilitar la interpretación, es útil conocer algunos de los grupos de caracteres más relevantes dentro de la tabla ASCII. Se pueden clasificar de la siguiente manera:

- Caracteres imprimibles: Incluyen letras, números y signos de puntuación, que son los más utilizados en el texto.

- Caracteres de control: Estos son comandos que no se representan visualmente, como el retorno de carro (CR) y la nueva línea (LF), que organizan el texto en la pantalla.

- Caracteres especiales: Signos como el más (+), igual (=), y asterisco (*) que son esenciales en la programación y en operaciones matemáticas.

Además, es importante recordar que el código ASCII se representa en diferentes formatos, como decimal, hexadecimal y binario. Entender estas representaciones permite a los programadores trabajar con distintos lenguajes y herramientas. Por ejemplo, el número decimal 65 también se puede expresar como 41 en hexadecimal y 1000001 en binario. Familiarizarse con estas conversiones es una habilidad valiosa en la programación.

Finalmente, conocer cómo se utiliza la tabla ASCII en la práctica es crucial. Los programadores a menudo utilizan funciones que requieren la conversión de caracteres a su correspondiente valor ASCII para realizar operaciones en cadenas de texto. Esta práctica es particularmente frecuente en la manipulación de datos, facilitando tareas como la búsqueda y reemplazo de caracteres dentro de un texto. Por ello, dominar la interpretación del código ASCII se convierte en un paso fundamental para cualquier aspirante a programador.

Errores Comunes al Usar el Código ASCII en Programación y Cómo Evitarlos

Al trabajar con el código ASCII, uno de los errores más comunes es el malentendido de la representación de caracteres. Muchos programadores asumen que todos los sistemas utilizan el mismo conjunto de caracteres, lo que puede llevar a errores de interpretación. Para evitar esto, es crucial asegurarse de que los archivos y las configuraciones de codificación sean consistentes en el entorno de desarrollo y producción. Esto incluye verificar que se utilice el mismo tipo de codificación, como UTF-8, para garantizar que los caracteres se manejen correctamente.

Otro error frecuente es no considerar los caracteres de control al manipular cadenas de texto. Estos caracteres, como el retorno de carro y el salto de línea, pueden alterar la salida del programa si no se gestionan adecuadamente. Para evitar confusiones, los programadores deben familiarizarse con estos caracteres y asegurarse de que se manejen correctamente durante la entrada y salida de datos. Una buena práctica es incluir comentarios en el código que aclaren el uso de estos caracteres en contextos específicos.

Además, la implementación de funciones que no consideran la extensión del ASCII puede llevar a problemas al trabajar con caracteres especiales. Algunos lenguajes de programación permiten la inclusión de caracteres más allá de los 128 estándares del ASCII, y asumir que solo se usarán estos puede resultar en errores. Es recomendable utilizar funciones que manejen explícitamente estos casos, así como validar la entrada de datos para evitar comportamientos inesperados. Esto incluye crear una lista de caracteres válidos y manejar excepciones donde sea necesario.

Finalmente, es importante recordar que la interoperabilidad entre diferentes plataformas puede ser problemática si no se tiene en cuenta la codificación del texto. Algunos sistemas pueden no soportar caracteres ASCII extendidos, lo que puede causar errores en la representación de datos. Para prevenir estos problemas, es recomendable realizar pruebas en múltiples plataformas y entornos, asegurando que el programa funcione correctamente en todos ellos. Crear una tabla de compatibilidad puede ayudar a identificar las diferencias y asegurar que el código sea robusto y adaptable.

Deja una respuesta

Contenido relacionado